インタビューを撮影して、本編にどの部分を使うかを決める作業には、長編になればなるほど「文字起こし」という作業が必要で、録音テープ時代からテープおこしとも言われてます。10年くらい前から映像編集アプリにも文字おこしの機能が付いていましたが、笑えるくらい使い物になりませんでした。しかしこの数年でエンジンが鍛えられて実用的になって昨年くらいから私も積極的に使うようになりました。特にGoogleの音声入力の進化で文字起こしの労力はかなり低減しました。昨年からその方法や認識の状況をテストしたものをYouTubeでシェアして来ましたが、今週アップしたものは最近精度良く認識さすために分ってきた事を動画にしました。

動画(FCPやQT)からの音声はデジタルで

Googleドキュメントで音声認識させるには、アナログ入力でも可能なのですが、なるべく品質の高い音声の方が認識が高いでデジタル入出力しています。パソコンによってはアナログのヘッドフォン出力をアナログのオーディオ入力とケーブルで繋ぐという方法やアプリで内部処理する方法もあります。私の場合はMacを使っていますのでSoundflowerというオーディオアプリケーションを使って内部処理していました。この方法だとFCPから直接再生した音でも認識さすことが無料で出来ます。それをまとめたのがコチラの動画。

しかしこの方法には欠点があって、再生中の音声をモニター出来ないのです。ヘッドフォンやスピーカーで鳴らしながらGoogleドキュメントに認識さす事が出来ないので、認識が止ったり、途中で時間や区切りを入れたい時に音が聞こえてないと、どこまで進んでいるのかは文字が頼りになるのですが、その文字が合っているのか間違っているのかの判断もリアルタイムで出来ないわけです。

Googleドキュメントは分りやすい言葉は比較的スムーズですが、一旦考え込むと、しばらく認識が止ってしまう事もあって、結局しばらくの間は認識をしないで飛ばしてしまうことがあります。このマイクの印が赤丸だけになった状態は認識頑張ってるけど、訳が判らなくなって考えている状態。

おそらく15秒この状態で止ると、その止っている時の言葉はテキスト化されず、飛ばして次に進んでしまう事があります。しかしそれはその間の言葉がまったく判らずに止っているわけではなく、また同じところからやれば認識する事もあるので、「難しくて困っていたら次々に考えさせられて困り果てて飛ばした」ような感じです。ですのでこれを回避するには、15秒止ってたら一旦停止して止ったと思われる所から再度再生する事をするとうまく行く事もあります。そういうアナログ的なサポートを手動でした方が、ごっそりと抜け落ちる事が少ないです。これは日々の性能アップで徐々に改善はされて行くと思いますが、現状はこういう状況です。

音聞きながらデジタル認識させるには

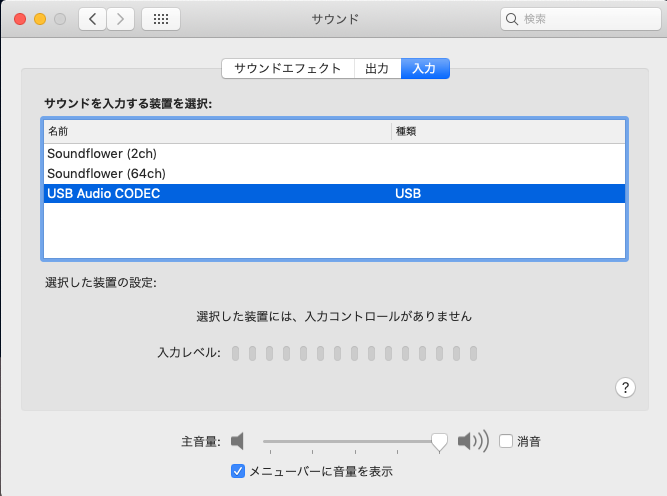

USBのオーディオインターフェースというものが各社から様々な用途で発売されていますが、私が持っていた小さなアナログミキサーにもUSBが付いています。Behringer Xenyx 302usbという機種ですが、パソコンのUSBにアナログのマイク、ライン入力と、そのバランス等を変化させるためのものですが、ミキサーとして高音、低音のイェクト、LRのパンも付いていますので、映像展示で音声を現場で少し変化させたい時などにも使えます。これをMacに繋ぐと音声の入出力にUSB Audio CODECというのが現れるので、それを選択すると内部で再生したものを再び内部で認識出来るようになります。ですので、FCPやQuickTimeで再生した映像の音声をGoogleドキュメントの音声入力が認識できるようになります。

右上にヘッドフォン出力が付いていますので、ここにヘッドフォンやアンプに接続しすれば、常に再生中の音声がモニター出来ます。また同様の機能でネットのライブ配信用に発売されているTASCAM(タスカム) US-42Wも同じ事が出来ます。こちらの方はライブ配信用の音声機材として効果音のメモリーやポンだしも可能です。

認識はマイクの種類によって差が出る

音声認識はその音質によっても認識が変わります。特に広い部屋で話をされているようなケースをガンマイクなどで拾っても音の広がりが大きく、なんとなくぼやけた音になっている事がありりますが、こういう音質は不得意だということが判りました。学校教室よりも大きいくらいの部屋でマイクを通されてた話しは、耳で聞く分には普通に言葉として聞こえて内容もよく理解出来るのですが、音声認識が言葉として認識する時には考え込む事がほとんどで、中にはまったく認識出来ない事もありました。今回のテストでは8畳くらいの部屋でピンマイクとガンマイクの音声で差を確認しましたが、結果は思っていたよりもありました。文字数を見れば歴然ですが、変換した言葉も音の広がりがあるガンマイクの方は間違っているものが増えます。それだけデジタルは不明瞭さを正確に反映しています。

昨年秋に検証した時の動画では屋外で話をして認識させています。

それでも85点と書いているので、マイクの性能やその距離なども含めて、音声として認識する要素がどこにあるのかを把握しておく必要があると思いました。現状ではピンマイクなどを使ってなるべく粒立ちの良い明瞭な音声を録っておくということが一番有効です。

方言や少し変わった言い回しに弱い

普通にタイプしても変換が難しい方言や言い回しは、音声入力にとっても難しく、音は正確に拾っていても間違って変換するために訳の分らない言葉になる事があります。訳の分らない文になると、Googleドキュメントがその前後の変換も変更しようとしますので、さらに間違った方向に進むことがあります。うまく出来てると思っていても、こういう部分があると5行くらいまとめて再度変換をやり直す事があって、改善する方向だと良いのですがまったく意味不明なものになってしまう事も起こってしまいます。ですのでそれを音声で聞きながら、間違った部分は再度認識をやり直した方早いので、最初に紹介したオーディオインターフェースを繋いでその都度確認という方法が現状ベストだと思います。いずれにしても文字起こしは、最初から自分でタイプするよりも労力は半減出来ますので、やろうと思うモチベーション維持のためにもとても有効なものだと思います。また認識や変換に進化がありましたら更新したいと思います。